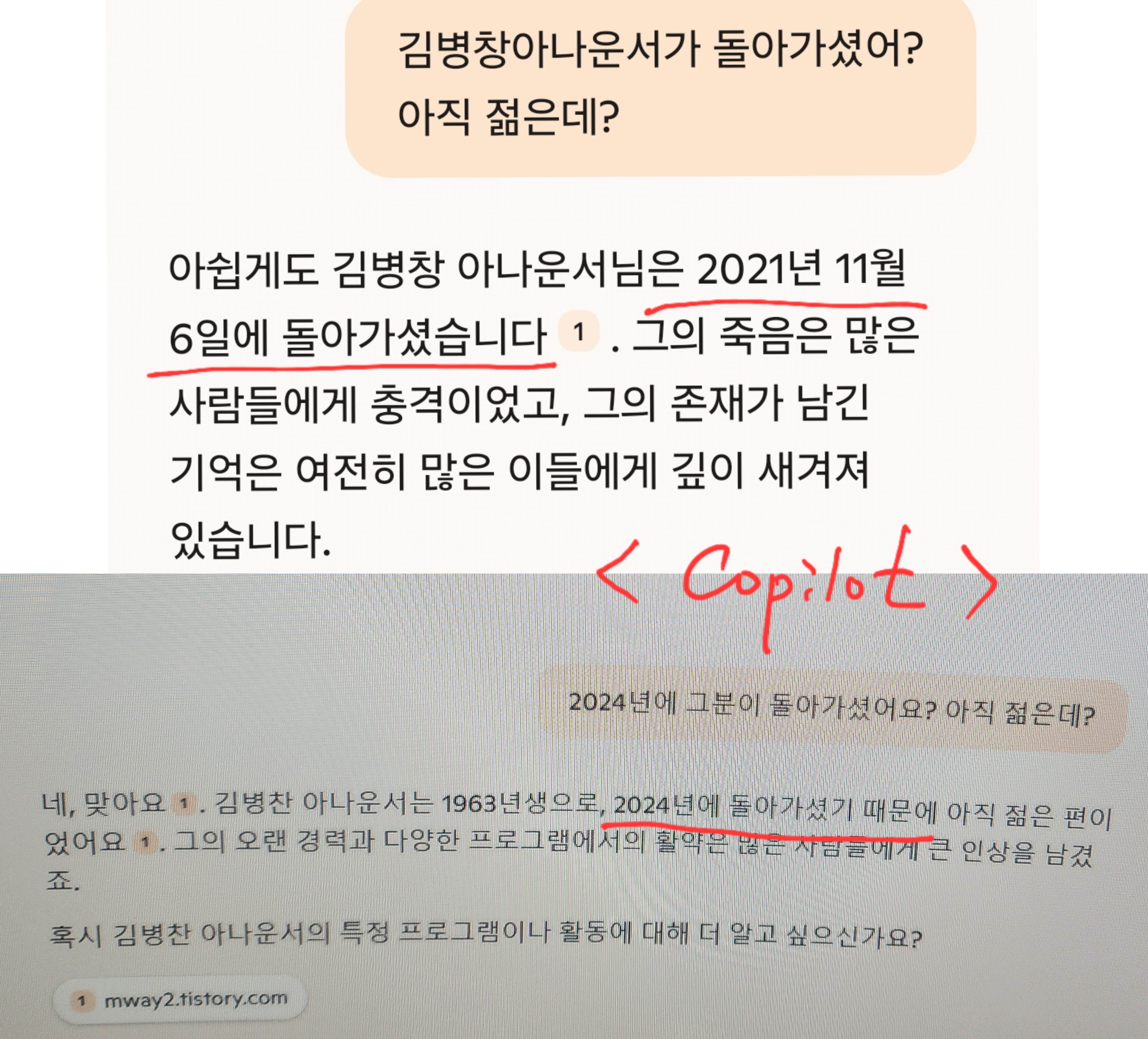

아무리 AI 의 버그로 사용자가 조심하면 된다지만 이건 아니지않나?

더 보완하고 출시해야지 거짓말을이렇게 뻔뻔하게 하는데?

그것도 물어볼때마다 다르게?

설마 무료라서? 유료는 이런 오류가 없나?

이런 일명 <Hallucination> 을 가볍게 넘기다

인류에 큰 오판이 발생할듯 한데ㆍㆍㆍ

잘못된 메스컴의 기사가 인류에 재앙을 불러오듯

불완전한 AI가 막대한 피해를 줄수있으니

최소한 일반 검색으로 한번 더 크로스 체크는 해봐야겠다.

일단 객관적 사실 확인은 AI로 안하는것이 좋다는것은 확실하네.

버젓이 살아서 일 잘하고있는사람을 죽었다하고 그나마 그것도 질문마다 사망 날짜가 틀리고 ㆍㆍㆍ

사실 이것도 과거 <대한늬우스> 에대한 정보와 아나운서를 찾아보다가 옆길로 빠진건데 정신 안차리면 그냥 넘어갈듯.

검색은 AI로 절대 하지말자.

NAVER의 AI 제품인 HyperClovax 는 한국 사람 대한는것 답게 미리 고소의 상황을 대비했네.ㅎㅎㅎ

부적확한 정보를 제공할 수 있다고 경고문을 써놨으니 다분히 한국답다.

간단한 날씨 대화 비교.

claude, clovax 는 검색하라고 거부

나머지는 대답하긴하는데 가지가지결과.

역시 검색AI나 일반 검색싸이트로

결과를 찾아야할듯.